摘要:基于深度学习的瓶子检测软件用于自动化瓶子检测与识别,对于各种场景下的塑料瓶、玻璃瓶等进行检测并计数,辅助计算机瓶子生产回收等工序。本文详细介绍深度学习的瓶子检测软件,在介绍算法原理的同时,给出Python的实现代码、训练数据集,以及PyQt的UI界面。基于YOLOv5算法实现对图像中存在的多个目标进行识别分类,在界面中可以选择各种图片、视频进行检测识别;博文提供了完整的Python代码和使用教程,适合新入门的朋友参考,完整代码资源文件请转至文末的下载链接。本博文目录如下:

目录

- 前言

- 1. 效果演示

- 2. 检测原理与训练

- 3. 瓶子检测识别

- 下载链接

- 结束语

➷点击跳转至文末所有涉及的完整代码文件下载页☇

参考博客文章:https://mbd.pub/o/bread/ZJaXlZ1q

参考视频演示:https://www.bilibili.com/video/BV1jM411W7Tz/

离线依赖库下载:https://pan.baidu.com/s/1hW9z9ofV1FRSezTSj59JSg?pwd=oy4n (提取码:oy4n )

前言

玻璃瓶、塑料瓶使用后可以回收再产,既有效解决废料垃圾的产生,同时也能够实现产品的循环利用。随着政府对环境友好型、资源节约型社会建设的不断深入,以及消费者本身环保节约意识的增强,玻璃包装逐渐成为政府鼓励类包装材料,消费者的认可程度也不断提升。各种玻璃瓶、塑料瓶的应用已然非常普遍,诸如:酒类、医包、日包等。

为了提高塑料瓶、玻璃瓶的生产线定位检测、回收利用等环节的效率,在当今全自动化生产趋势下,需要配合机床、机器人等识别和定位瓶子位置,传统的人工目测显然不是一个好的解决方案。各企业急需一套全自动化的检测方案,来解决这个难以平衡的矛盾。

本系统基于YOLOv5算法实现,采用登录注册进行用户管理,对于图片、视频和摄像头捕获的实时画面,可检测瓶子,系统支持结果记录、展示和保存,每次检测的结果记录在表格中。对此这里给出博主设计的界面,同款的简约风,功能也可以满足图片、视频和摄像头的识别检测,希望大家可以喜欢,初始界面如下图:

检测类别时的界面截图(点击图片可放大)如下图,可识别画面中存在的多个类别,也可开启摄像头或视频检测:

详细的功能演示效果参见博主的B站视频或下一节的动图演示,觉得不错的朋友敬请点赞、关注加收藏!系统UI界面的设计工作量较大,界面美化更需仔细雕琢,大家有任何建议或意见和可在下方评论交流。

1. 效果演示

首先我们还是通过动图看一下识别的效果,系统主要实现的功能是对图片、视频和摄像头画面中的瓶子进行识别,识别的结果可视化显示在界面和图像中,另外提供多个目标的显示选择功能,演示效果如下。

(一)系统介绍

基于深度学习的瓶子检测软件主要用于日常塑料瓶、玻璃瓶等瓶子检测,利用深度学习技术检测识别瓶子数目,可视化检测结果;可对图片、视频、摄像设备得到的图像进行分析,自动标记和记录检测结果,辅助计算机进行瓶子生产回收等工序;深度学习模型可方便切换和更新,已针对不同场景进行模型调整;提供用户登录注册功能,方便用户管理和使用;检测结果易于查看、记录和保存。

(二)技术特点

(1)检测算法采用YoloV5实现,模型可切换更新;

(2)定位图片、视频或摄像头等图像中瓶子位置;

(3)检测结果实时性强,便携展示、记录和保存;

(4)支持用户登录、注册、管理、界面可视化等功能;

(三)用户注册登录界面

这里设计了一个登录界面,可以注册账号和密码,然后进行登录。界面还是参考了当前流行的UI设计,左侧是一个动图,右侧输入账号、密码、验证码等等。

(四)选择图片识别

系统允许选择图片文件进行识别,点击图片选择按钮图标选择图片后,显示所有识别的结果,可通过下拉选框查看单个结果,以便具体判断某一特定目标。本功能的界面展示如下图所示:

(五)视频识别效果展示

很多时候我们需要识别一段视频中的多个瓶子,这里设计了视频选择功能。点击视频按钮可选择待检测的视频,系统会自动解析视频逐帧识别多个瓶子,并将瓶子的分类和计数结果记录在右下角表格中,效果如下图所示:

(六)摄像头检测效果展示

在真实场景中,我们往往利用摄像头获取实时画面,同时需要对瓶子进行识别,因此本文考虑到此项功能。如下图所示,点击摄像头按钮后系统进入准备状态,系统显示实时画面并开始检测画面中的瓶子,识别结果展示如下图:

2. 检测原理与训练

(一)基于YoloV5的瓶子检测

YOLOv5( You Only Look Once ) 是 由 UltralyticsLLC 公司于 2020 年 5 月份提出,其图像推理速度最快达 0.007 s,即每秒可处理 140 帧,满足视频图像实时检测需求,同时结构更为小巧,YOLOv5s 版本的权重数据文件为 YOLOv4的 1/9,大小为 27 MB。YOLOv5处理流程为:

(1)先将输入图片缩放到固定大小 640×640,再假想地将图片切分为 7×7个网格;

(2)对整张图像做卷积运算,每个小网格负责 2 个回归框的和置信度的预测,同时每个小网格还要预测出来 20 个类别,以及属于这些类别的条件概率。

(3)使用非极大值抑制法,对输出结果—类别和位置进行筛选处理。

YOLO 最大的特长是由于只看一次,所以速度极快,但是准确率跟当下最好的检测器相比有差距。对于出现在同一个网格里,距离很近的两个小目标,经常出现漏检等情况。

Yolov5 按照网络深度大小和特征图宽度大小分为 Yolov5s、 Yolov5m、Yolov5l、Yolov5,本文采用了 yolov5s 作为使用模型。Yolov5 的结构分为 input,backbone,Neck, 预测层。

(1)在输入端使用了 Mosaic 的数据增强方式,随机调用 4 张图片,随机大小和分布,进行堆叠,丰富了数据,增加了很多小目标,提升小物体的识别能力。可以同时计算 4 张图片,相当于增加了 Mini-batch 大小,减少了GPU 内存的消耗。Yolov5 首先也可以通过聚类设定anchor大小,然后还可以在训练过程中,在每次训练时,计算不同训练集中的ahchor值。然后在预测时使用了自适应图片大小的缩放模式,通过减少黑边,提高了预测速度。

(2) 在 Backbone 上 的 主 要 是 采 用 了Focus 结构,CSPnet 结构。Focus 结构不存在与 YOLOv3和 v4 版本中,其关键步骤为切片操作,如下图 所示。例如将原始图像 416* 416* 3 接入 Focus 结构中,通过切片操作,变为 208* 208* 12 的特征图,接下来进行一次 32 个卷积核操作,变为 208* 208* 32 的特征图。

(二)数据集和训练

这里我们使用的瓶子识别数据集,包含训练数据集1486张图片,验证集248张图片,验证集125张图片,共计1859张图片。数据集部分图像及其标注信息如下图所示:

每张图像均提供了图像类标记信息,图像中瓶子的bounding box,瓶子的关键part信息,以及瓶子的属性信息,数据集并解压后得到如下的图片。

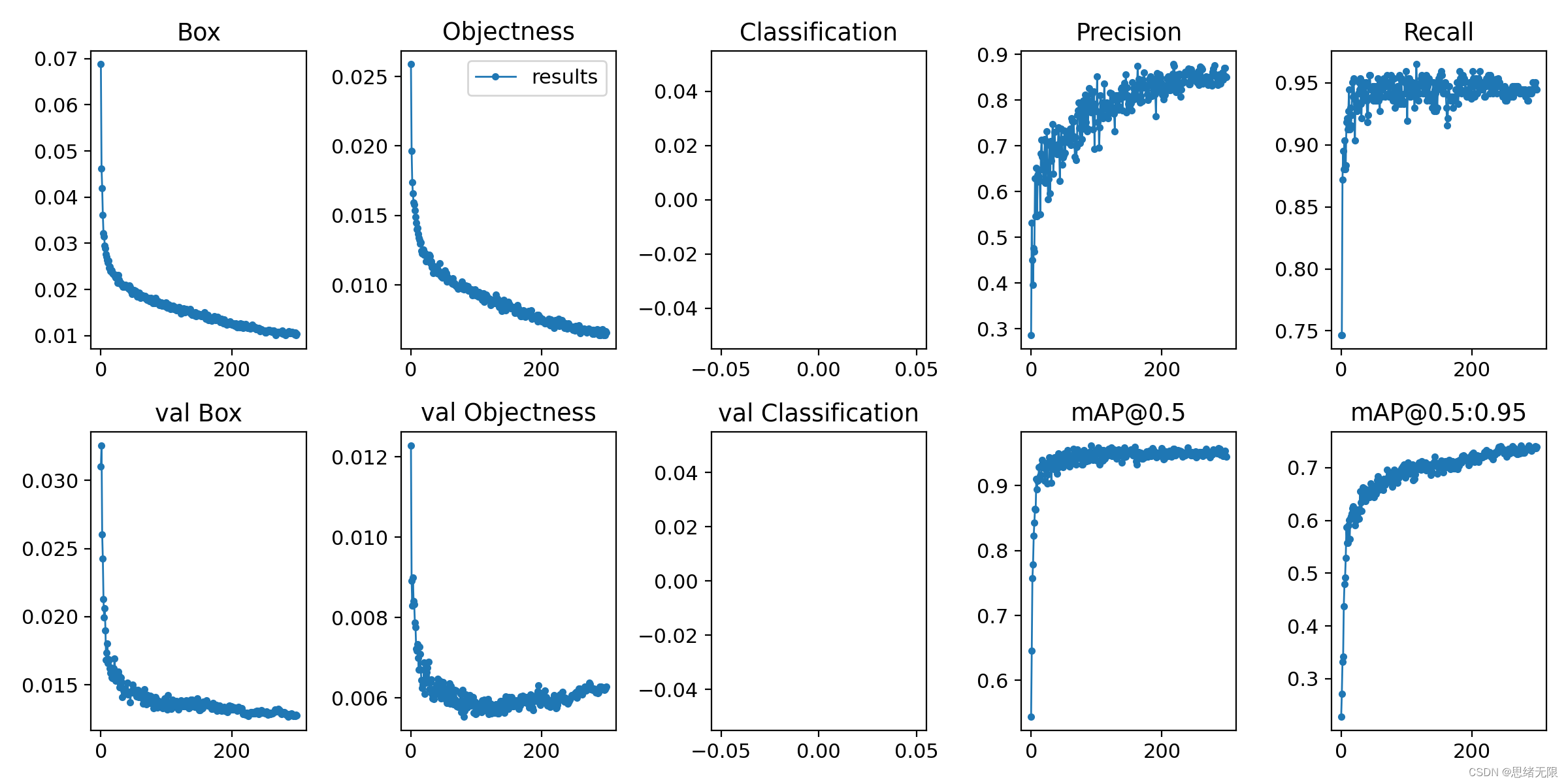

在深度学习中,我们通常通过损失函数下降的曲线来观察模型训练的情况。而YOLOv5训练时主要包含三个方面的损失:矩形框损失(box_loss)、置信度损失(obj_loss)和分类损失(cls_loss),在训练结束后,我们也可以在logs目录下找到生成对若干训练过程统计图。下图为博主训练瓶子类识别的模型训练和曲线图。

YOLOv5训练时主要包含三个方面的损失:矩形框损失(box_loss)、置信度损失(obj_loss)和分类损失(cls_loss),下图为博主训练交通标志类识别的模型训练曲线图。

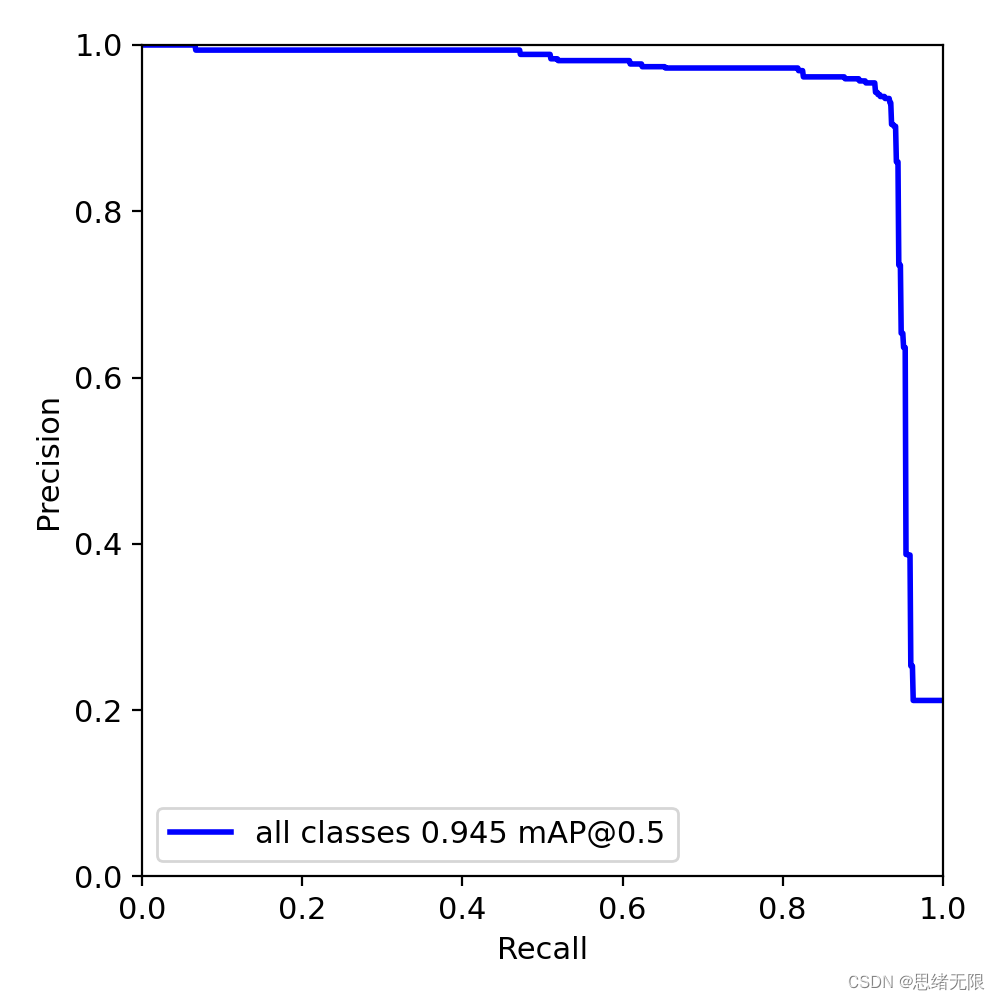

一般我们会接触到两个指标,分别是召回率recall和精度precision,两个指标p和r都是简单地从一个角度来判断模型的好坏,均是介于0到1之间的数值,其中接近于1表示模型的性能越好,接近于0表示模型的性能越差,为了综合评价目标检测的性能,一般采用均值平均密度map来进一步评估模型的好坏。绘制出来可以得到如下图所示的曲线。

以PR-curve为例,可以看到我们的模型在验证集上的均值平均准确率为0.945。

3. 瓶子检测识别

在训练完成后得到最佳模型,接下来我们将帧图像输入到这个网络进行预测,从而得到预测结果,预测方法(predict.py)部分的代码如下所示:

def predict(img): img = torch.from_numpy(img).to(device) img = img.half() if half else img.float() img /= 255.0 if img.ndimension() == 3: img = img.unsqueeze(0) t1 = time_synchronized() pred = model(img, augment=False)[0] pred = non_max_suppression(pred, opt.conf_thres, opt.iou_thres, classes=opt.classes, agnostic=opt.agnostic_nms) t2 = time_synchronized() InferNms = round((t2 - t1), 2) return pred, InferNms得到预测结果我们便可以将帧图像中的瓶子框出,然后在图片上用opencv绘图操作,输出瓶子的类别及瓶子的预测分数。以下是读取一个瓶子图片并进行检测的脚本,首先将图片数据进行预处理后送predict进行检测,然后计算标记框的位置并在图中标注出来。

if __name__ == '__main__':# video_path = 0 video_path = "./UI_rec/test_/瓶子检测视频.mp4" # 初始化视频流 vs = cv2.VideoCapture(video_path) (W, H) = (None, None) frameIndex = 0 # 视频帧数 try: prop = cv2.CAP_PROP_FRAME_COUNT total = int(vs.get(prop)) # print("[INFO] 视频总帧数:{}".format(total)) # 若读取失败,报错退出 except: print("[INFO] could not determine # of frames in video") print("[INFO] no approx. completion time can be provided") total = -1 fourcc = cv2.VideoWriter_fourcc(*'XVID') ret, frame = vs.read() vw = frame.shape[1] vh = frame.shape[0] print("[INFO] 视频尺寸:{} * {}".format(vw, vh)) output_video = cv2.VideoWriter("./results.avi", fourcc, 20.0, (vw, vh)) # 处理后的视频对象 # 遍历视频帧进行检测 while True: # 从视频文件中逐帧读取画面 (grabbed, image) = vs.read() # 若grabbed为空,表示视频到达最后一帧,退出 if not grabbed: print("[INFO] 运行结束...") output_video.release() vs.release() exit() # 获取画面长宽 if W is None or H is None: (H, W) = image.shape[:2] image = cv2.resize(image, (850, 500)) img0 = image.copy() img = letterbox(img0, new_shape=imgsz)[0] img = np.stack(img, 0) img = img[:, :, ::-1].transpose(2, 0, 1) # BGR to RGB, to 3x416x416 img = np.ascontiguousarray(img) pred, useTime = predict(img) det = pred[0] p, s, im0 = None, '', img0 if det is not None and len(det): # 如果有检测信息则进入 det[:, :4] = scale_coords(img.shape[1:], det[:, :4], im0.shape).round() # 把图像缩放至im0的尺寸 number_i = 0 # 类别预编号 detInfo = [] for *xyxy, conf, cls in reversed(det): # 遍历检测信息 c1, c2 = (int(xyxy[0]), int(xyxy[1])), (int(xyxy[2]), int(xyxy[3])) # 将检测信息添加到字典中 detInfo.append([names[int(cls)], [c1[0], c1[1], c2[0], c2[1]], '%.2f' % conf]) number_i += 1 # 编号数+1 label = '%s %.2f' % (names[int(cls)], conf) # 画出检测到的目标物 plot_one_box(image, xyxy, label=label, color=colors[int(cls)]) # 实时显示检测画面 cv2.imshow('Stream', image) image = cv2.resize(image, (vw, vh)) output_video.write(image) # 保存标记后的视频 if cv2.waitKey(1) & 0xFF == ord('q'): break # print("FPS:{}".format(int(0.6/(end-start)))) frameIndex += 1执行得到的结果如下图所示,图中瓶子的种类和置信度值都标注出来了,预测速度较快。基于此模型我们可以将其设计成一个带有界面的系统,在界面上选择图片、视频或摄像头然后调用模型进行检测。

博主对整个系统进行了详细测试,最终开发出一版流畅得到清新界面,就是博文演示部分的展示,完整的UI界面、测试图片视频、代码文件,以及Python离线依赖包(方便安装运行,也可自行配置环境),均已打包上传,感兴趣的朋友可以通过下载链接获取。

下载链接

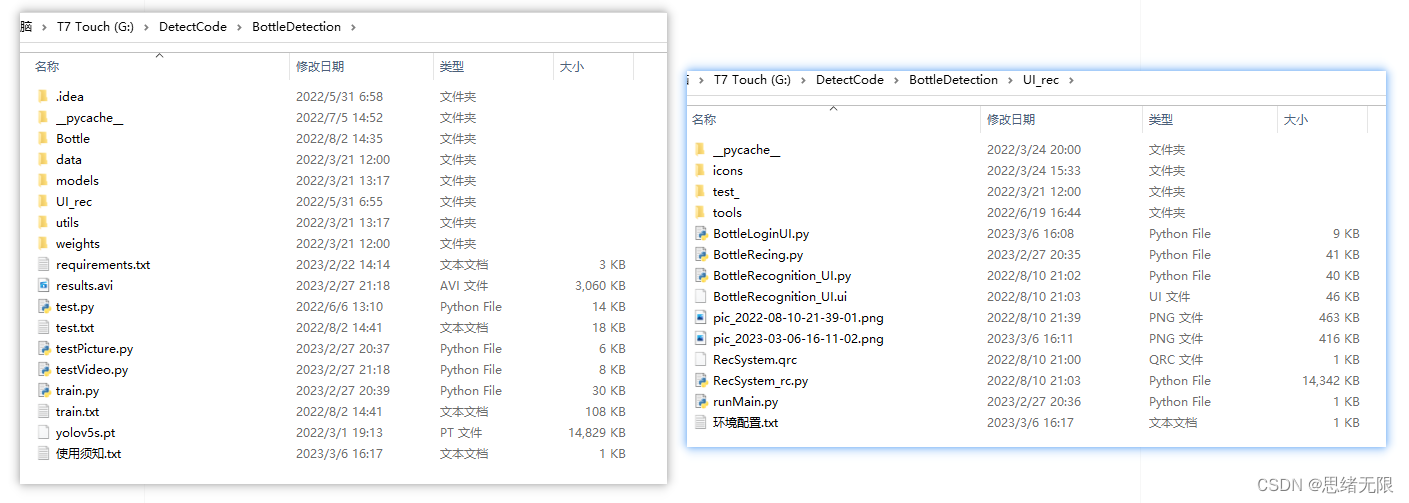

若您想获得博文中涉及的实现完整全部程序文件(包括测试图片、视频,py, UI文件等,如下图),这里已打包上传至博主的面包多平台,见可参考博客与视频,已将所有涉及的文件同时打包到里面,点击即可运行,完整文件截图如下:

在文件夹下的资源显示如下,其中包含了Python的离线依赖包,读者可在正确安装Anaconda和Pycharm软件后,点击bat文件进行安装,详细演示也可见本人B站视频。

注意:该代码采用Pycharm+Python3.8开发,经过测试能成功运行,运行界面的主程序为runMain.py和LoginUI.py,测试图片脚本可运行testPicture.py,测试视频脚本可运行testVideo.py。为确保程序顺利运行,请按照requirements.txt配置Python依赖包的版本。Python版本:3.8,请勿使用其他版本,详见requirements.txt文件;

完整资源中包含数据集及训练代码,环境配置与界面中文字、图片、logo等的修改方法请见视频,项目完整文件下载请见参考博客文章里面,或参考视频的简介处给出:➷➷➷

参考博客文章:https://mbd.pub/o/bread/ZJaXlZ1q

参考视频演示:https://www.bilibili.com/video/BV1jM411W7Tz/

离线依赖库下载:https://pan.baidu.com/s/1hW9z9ofV1FRSezTSj59JSg?pwd=oy4n (提取码:oy4n )

界面中文字、图标和背景图修改方法:

在Qt Designer中可以彻底修改界面的各个控件及设置,然后将ui文件转换为py文件即可调用和显示界面。如果只需要修改界面中的文字、图标和背景图的,可以直接在ConfigUI.config文件中修改,步骤如下:

(1)打开UI_rec/tools/ConfigUI.config文件,若乱码请选择GBK编码打开。

(2)如需修改界面文字,只要选中要改的字符替换成自己的就好。

(3)如需修改背景、图标等,只需修改图片的路径。例如,原文件中的背景图设置如下:

mainWindow = :/images/icons/back-image.png可修改为自己的名为background2.png图片(位置在UI_rec/icons/文件夹中),可将该项设置如下即可修改背景图:

mainWindow = ./icons/background2.png结束语

由于博主能力有限,博文中提及的方法即使经过试验,也难免会有疏漏之处。希望您能热心指出其中的错误,以便下次修改时能以一个更完美更严谨的样子,呈现在大家面前。同时如果有更好的实现方法也请您不吝赐教。

人工智能博主,机器学习及机器视觉爱好者,公众号主及B站UP主,专注专业知识整理与项目总结约稿、软件项目开发、原理指导请联系微信:sixuwuxian(备注来意),邮箱:sixuwuxian@aliyun.com,微信公众号:“AI技术研究与分享”。